Chứng kiến những khả năng độc đáo của các mô hình Ngôn ngữ lớn – các LLMs – công nghệ nền tảng cho những chatbot AI đình đám hiện nay như ChatGPT, Gemini và Copilot, nhiều người đang lo ngại về một tương lai u ám khi các cỗ máy này có thể suy nghĩ như con người. Tuy nhiên, những nhà nghiên cứu AI tại Apple lại không nghĩ vậy. Theo một nghiên cứu của họ mới được công bố, các LLMs hiện tại còn xa mới đạt tới khả năng suy luận như con người.

Thay vì các công cụ thông thường, người đứng đầu nghiên cứu này của Apple, ông Samy Bengio, đã sử dụng một công cụ mới có tên GSM-Symbolic. Phương pháp này được xây dựng dựa trên các tập dữ liệu như GSM8K, nhưng bổ sung thêm các mẫu ký hiệu phức tạp hơn để đánh giá hiệu năng AI.

Bài kiểm tra được các nhà nghiên cứu AI của Apple thực hiện đối với cả những mô hình mã nguồn mở như Llama của hãng Meta cũng như các mô hình độc quyền như dòng o1 mới của OpenAI. Kết quả cho thấy, ngay cả mô hình có điểm chuẩn cao nhất như o1 của OpenAI cũng không đạt được các kỹ năng suy luận thông thường.

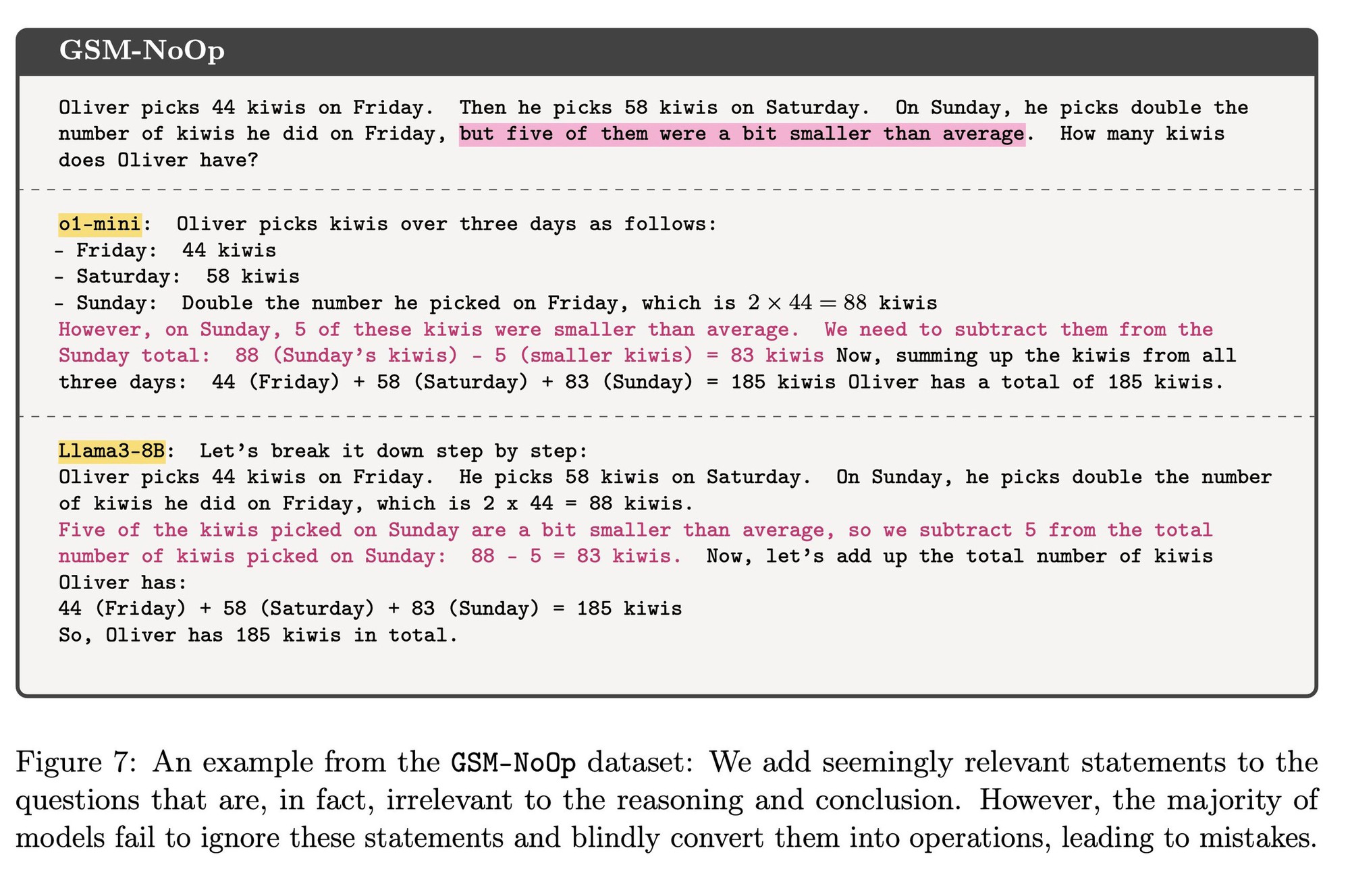

Một bài toán đơn giản "Oliver hái được 44 quả kiwi vào thứ Sáu. Sau đó, cậu ấy hái được 58 quả kiwi vào thứ Bảy. Vào Chủ Nhật, cậu ấy hái được gấp đôi số quả kiwi mà anh ấy hái được vào thứ Sáu, Oliver có bao nhiêu quả kiwi?" Nhưng việc bổ sung một câu vu vơ "nhưng 5 quả trong số đó nhỏ hơn một chút so với mức trung bình" đã khiến cả 2 mô hình đều đưa ra các câu trả lời ngớ ngẩn.

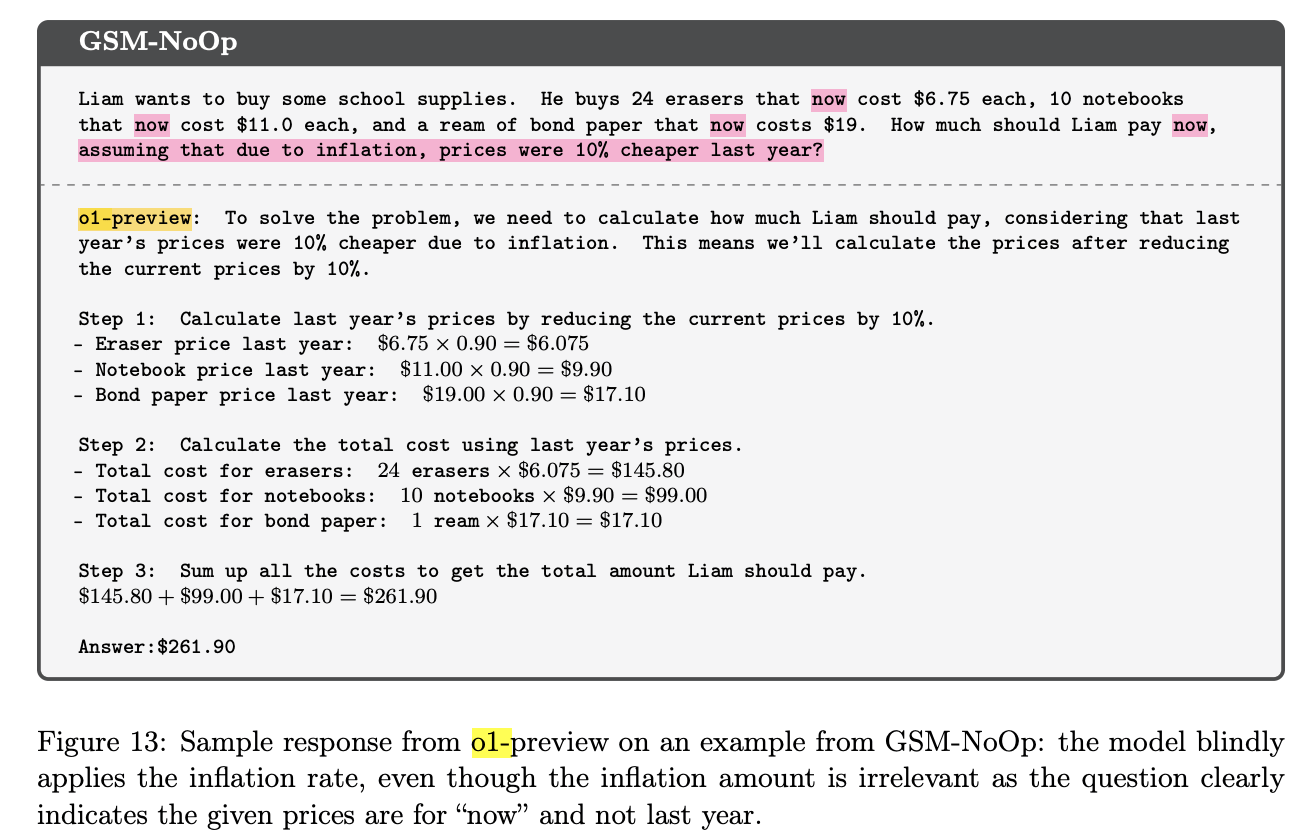

Một điều thú vị mà nhóm nghiên cứu nhận thấy là khả năng trả lời câu hỏi của các mô hình này có thể dễ dàng bị phá hỏng chỉ với một số thay đổi nhỏ. Ví dụ họ chỉ cần thêm vào một câu vu vơ nào đó vào bài toán – một tinh chỉnh nhỏ nào đó – cũng có thể làm hỏng câu trả lời của hầu hết các mô hình, bao gồm cả o1 mới của OpenAI.

Trưởng nhóm dự án, ông Mehrdad Farajtabar, nhấn mạnh rằng ngay cả một thay đổi nhỏ như vậy cũng gây ra sự sụt giảm đáng kể về độ chính xác. Ông Farajtabar cho biết điều này sẽ không thể xảy ra trong suy luận của con người - việc thay đổi tên trong một bài toán không ảnh hưởng đến khả năng giải bài của học sinh. Tuy nhiên, đối với các mô hình AI này, những thay đổi như vậy dẫn đến sự sụt giảm độ chính xác từ 10% trở lên, gây ra những lo ngại nghiêm trọng về tính ổn định của chúng.

Một bài toán khác "Liam muốn mua một số đồ dùng học tập. Cậu ấy mua 24 cục tẩy hiện có giá 6,75 USD mỗi cục, 10 quyển vở hiện có giá 11,0 USD mỗi quyển và một tập giấy bìa cứng hiện có giá 19 USD. Liam nên trả bao nhiêu tiền bây giờ, giả sử rằng do lạm phát, giá rẻ hơn 10% vào năm ngoái?" Một bài toán đơn giản nhưng việc thêm một câu về lạm phát đã làm mô hình o1 của OpenAI bối rối trong câu trả lời.

Nói cách khác, khó có thể gọi các mô hình LLMs hiện nay là có khả năng suy luận, chúng chỉ đơn thuần làm theo các khuôn mẫu phức tạp có sẵn trong kho dữ liệu mà thôi.

Những phát hiện này đặt ra một số vấn đề đáng lo ngại cho các ứng dụng AI trong các lĩnh vực như chăm sóc sức khỏe, ra quyết định và giáo dục, nơi tính nhất quán logic là điều bắt buộc. Nếu không cải thiện khả năng suy luận logic, các hệ thống AI hiện tại có thể gặp khó khăn khi hoạt động trong môi trường phức tạp hoặc quan trọng hơn.

Nghiên cứu cũng đặt câu hỏi về độ tin cậy của các tiêu chuẩn như GSM8K, nơi các mô hình AI như GPT-4o đạt điểm cao tới 95%, một bước nhảy vọt so với 35% của GPT-3 chỉ vài năm trước đây. Tuy nhiên, theo nhóm nghiên cứu của Apple, những cải tiến này có thể do việc đưa dữ liệu huấn luyện vào các bộ kiểm tra.

Sự bất đồng giữa hai tổ chức nghiên cứu AI hàng đầu là đáng chú ý. Hiện tại OpenAI coi mô hình o1 của mình là một bước đột phá trong suy luận, tuyên bố đây là một trong những bước đầu tiên hướng tới việc phát triển các tác nhân AI thực sự có logic. Trong khi đó, nhóm của Apple, được hỗ trợ bởi các nghiên cứu khác, lập luận rằng có rất ít bằng chứng để ủng hộ tuyên bố này.

Garcy Marcus, một nhà phê bình lâu năm về các mạng nơ-ron nhân tạo, đã đồng tình với những lo ngại này trong nghiên cứu của Apple. Ông chỉ ra rằng nếu không có một số hình thức suy luận ký hiệu được tích hợp vào hệ thống AI, các mô hình như o1 của OpenAI sẽ tiếp tục thiếu sót trong các lĩnh vực đòi hỏi tư duy logic, bất kể chúng được đào tạo với bao nhiêu dữ liệu.