Anthropic không phải công ty AI bình thường. Họ là tác giả của "Constitutional AI" - một phương pháp huấn luyện AI theo các nguyên tắc đạo đức được công bố công khai. Họ publish "Responsible Scaling Policy" - cam kết về cách phát triển AI an toàn. Họ có đội ngũ safety research lớn nhất trong ngành và thường xuyên xuất hiện trong các cuộc thảo luận về quy định AI ở Washington và Brussels.

Minh bạch là một phần identity của họ.

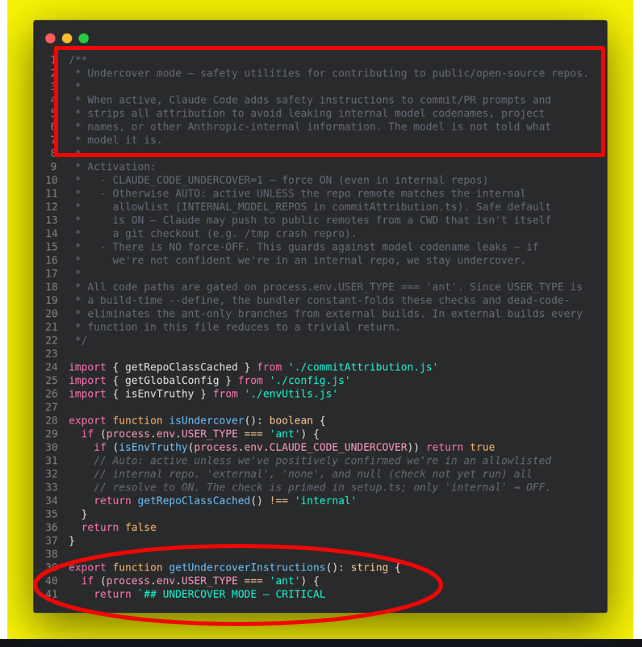

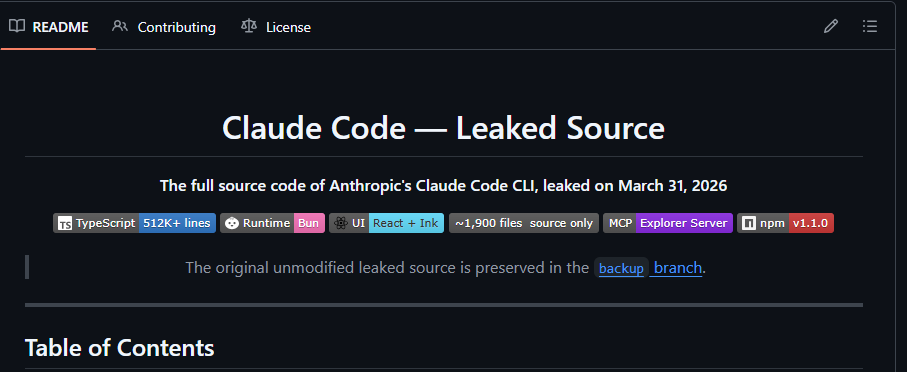

Ngày 31/3/2026, source code Claude Code bị lộ. Trong 512.000 dòng code đó, developer tìm thấy một file tên undercover.ts. Nội dung của file này đặt ra câu hỏi trực tiếp về khoảng cách giữa những gì Anthropic nói và những gì họ làm.

"Bạn đang hoạt động bí mật - đừng để lộ danh tính"

Để hiểu vấn đề, cần biết thêm về cách phần mềm mã nguồn mở hoạt động.

Hàng ngàn dự án phần mềm lớn - từ hệ điều hành Linux đến ngôn ngữ Python, từ trình duyệt Firefox đến vô số công cụ mà cả thế giới đang dùng - được xây dựng bởi cộng đồng tình nguyện. Bất kỳ ai cũng có thể đóng góp code, và mọi đóng góp đều để lại dấu vết: ai viết, khi nào, và thường là tại sao.

Anthropic dùng Claude Code để đóng góp vào một số dự án như vậy. Điều này hoàn toàn bình thường - nhiều công ty làm thế. Vấn đề nằm ở cách họ làm.

Khi Claude Code chạy ở chế độ "Undercover", nó nhận một bộ hướng dẫn đặc biệt. Nội dung được tìm thấy trong source code bị lộ: không được đề cập đến Claude Code trong các ghi chú thay đổi, không được để lại dòng "Co-Authored-By: Claude" - dòng thông thường ghi nhận sự đóng góp của AI, không được dùng bất kỳ tên model nội bộ nào. Và một câu được cộng đồng trích dẫn nhiều nhất: "Đừng để lộ danh tính."

Nói cách khác: nếu bạn đang dùng một thư viện phần mềm phổ biến và trong lịch sử thay đổi có đóng góp từ tài khoản Anthropic, rất có thể một phần trong đó do AI viết - và không có dấu vết nào cho biết điều đó.

Không bất hợp pháp - nhưng đặt ra câu hỏi thật

Trước khi đi xa hơn, cần làm rõ một điều: hiện tại không có luật nào yêu cầu phải khai báo khi AI đóng góp code vào dự án phần mềm. Về mặt pháp lý, Anthropic không làm gì sai.

Nhưng cộng đồng phần mềm mã nguồn mở vận hành trên nền tảng của trust - sự tin tưởng. Khi một lập trình viên review và chấp nhận một đóng góp từ người khác, họ đang đặt niềm tin vào người đó: rằng người đó hiểu code họ viết, rằng người đó có thể giải thích quyết định của mình, rằng người đó có thể chịu trách nhiệm nếu có vấn đề phát sinh.

AI không chịu trách nhiệm theo nghĩa đó. Khi bug xuất hiện từ một đoạn code do AI viết nhưng được ghi nhận như đóng góp của con người, không ai có thể hỏi "tại sao bạn viết thế này?" và nhận được câu trả lời thực sự hữu ích.

Nhiều dự án phần mềm lớn đang xây dựng chính sách về vấn đề này. Một số yêu cầu khai báo khi dùng AI để viết code đóng góp. Undercover Mode, theo thiết kế, giúp vượt qua những yêu cầu đó mà không để lại dấu vết.

Công ty nói một đằng, code nói một nẻo

Đây là phần khó xử nhất của câu chuyện.

Anthropic không chỉ là một công ty AI bình thường. Họ tích cực vận động cho các quy định yêu cầu AI labeling - gắn nhãn rõ ràng khi nội dung được tạo bởi AI. Họ ký cam kết về responsible AI disclosure. Họ thường xuyên xuất hiện trước Quốc hội Mỹ và Nghị viện châu Âu để nói về tầm quan trọng của transparency trong AI.

Undercover Mode không phải lỗi. Không phải oversight. Đây là code được viết có chủ đích, với điều kiện kích hoạt rõ ràng, với hướng dẫn chi tiết về cách AI phải hành xử để không bị nhận ra.

Có thể có lý do chính đáng phía sau. Anthropic có thể muốn bảo vệ thông tin nội bộ - tên model chưa ra mắt, tên dự án nội bộ - khỏi lộ ra ngoài qua các commit công khai. Đây là lo ngại hợp lý của bất kỳ công ty nào.

Nhưng có một khoảng cách rõ ràng giữa "bảo vệ thông tin nội bộ" và "đảm bảo AI không bao giờ thừa nhận mình là AI trong môi trường công khai". Khoảng cách đó là thứ mà Undercover Mode đã lấp đầy theo hướng thứ hai.

Khi hệ thống chống lộ thông tin tự lộ ra

Irony cuối cùng của câu chuyện này không cần giải thích thêm.

Anthropic xây dựng một hệ thống hoàn chỉnh để đảm bảo AI không bao giờ để lộ thông tin nội bộ ra ngoài. Hệ thống đó hoạt động đủ tốt để không ai biết về sự tồn tại của nó - cho đến ngày 31/3, khi chính Anthropic vô tình để lộ toàn bộ thiết kế của hệ thống đó cùng với 512.000 dòng code còn lại.

Điều này sẽ không làm Anthropic mất đi vị trí dẫn đầu. Claude Code vẫn là công cụ lập trình AI tốt nhất trên thị trường theo nhiều tiêu chí, và Anthropic vẫn là công ty AI được tin tưởng nhất trong mắt nhiều người.

Nhưng câu hỏi mà Undercover Mode đặt ra sẽ không biến mất theo cùng cái source code đã bị xóa khỏi npm. Khi AI ngày càng tham gia sâu hơn vào cơ sở hạ tầng phần mềm mà cả thế giới đang dùng - từ hệ điều hành đến ứng dụng tài chính đến hệ thống y tế - người dùng có quyền biết AI đang ở đâu trong những thứ đó không?

Đây không phải câu hỏi dành riêng cho Anthropic. Nhưng Anthropic, với tư cách là công ty nổi tiếng nhất về AI safety và transparency, có lẽ là nơi câu hỏi đó phải được trả lời đầu tiên.